| MONOGRÁFICO: Sordera y Nuevas Tecnologías |

|

|

|

| CAJON DE SASTRE - Cajon de sastre |

| Escrit per Marc Monfort, Adoración Juárez Sánchez, Juan Martínez Sanjose, Barker N, Bermejo S, Gascón R, Mazagatos L, onrrubia E, Sánchez O. |

| dimarts, 31 d'octubre de 2006 19:20 |

|

There are no translations available. Desde que se inició la educación de las personas con sordera pre-lingual, se buscaron medios para poder compensar la deficiencia auditiva y para eliminar las dificultades de comunicación.

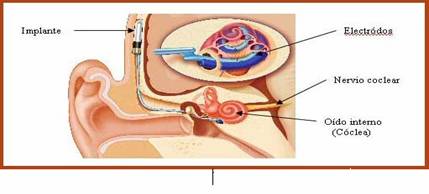

Sordera y Tecnología.La falta de audición es una discapacidad cuyo impacto es a menudo infravalorado debido al hecho de su poca visibilidad: sin embargo, no poder oír supone una perturbación muy grave de la comunicación, basada fundamentalmente en el lenguaje oral : cualquier perturbación permanente de la comunicación conduce inevitablemente al aislamiento social. Atendiendo también a aquellos que sufren una pérdida auditiva tardía, el diseño de instrumentos mecánicos de amplificación del sonido que se nos pueden antojar hoy por hoy estrambóticos, anunciaba sin embargo el camino que iban a emprender los amplificadores, los trasmisores tactiles y las prótesis auditivas cuando se pudo recurrir a la electricidad. Hay que reconocer que, sobre todo para los casos de mayor pérdida auditiva, los progresos tecnológicos centrados directamente en la causa de las dificultades, es decir la falta de audición, fueron más lentos de lo que se podía esperar, cuando el conocimiento de la acústica y de la fisiología de la audición seguía siendo más bien esquemático. Suponían beneficios substanciales y, gracias a ellos, los educadores consiguieron altos niveles de oralización en muchos de sus alumnos pero no eran capaces de restaurar la función auditiva en aquellas personas con discapacidad auditiva profunda. Por ello, a lo largo del signo XX, la mejoría de la educación y de la calidad de vida de las personas sordas se consiguió fundamentalmente a través de programas educativos y sociales. Por un lado, desde la perspectiva de la reducción de barreras de comunicación, se produjo una inflación superlativa de la comunicación visual, mediante teléfono (mensajes SMS), fax o internet : para las personas sin audición, esta alternativa a la comunicación audio-oral por teléfono tradicional (una de sus grandes frustraciones al limitar su autonomía personal) ha supuesto un cambio enorme en su vida. Las posibilidades de subtitulación, con una presencia creciente en televisión, no han sido sin embargo apenas aprovechadas en toda su extensión : queda todavía todo un futuro por construir. Cuando la técnica de reconocimiento vocal lo permita, la visualización escrita de lo que dice un hablante, en tiempo real, permitirá un acceso completo y autónomo a la información en cualquier evento público (clases de universidad, conferencia...) ; supondrá la resolución de muchos problemas de comunicación interpersonal, con un coste que se irá probablemente reduciendo con la generalización del uso de dicha tecnología. En la actualidad, es posible proporcionarles un nivel de audición tan eficaz como en cualquier otro niño lo que cambia profundamente su situación vital. El desarrollo científico ha generado muchos monstruos pero es motivo de orgullo para nuestra especie que sirva también para reducir las diferencias individuales que, a veces una naturaleza injusta, otras veces una sociedad insensible han generado entre nosotros. Contribución del Implante Coclear en el desarrollo del lenguaje oral en el niño sordoIntroducciónLa tecnología desarrollada a lo largo del pasado siglo XX y al inicio del XXI nos ha dotado de nuevas herramientas capaces de corregir la deficiencia auditiva: el modelo de amplificación utilizado por las prótesis auditivas convencionales digitales es muy eficaz para corregir perdidas medianas y severas pero es el implante coclear el que ha representado un cambio cualitativo en el campo de las sorderas profundas. El implante coclear hace posible que un niño sordo profundo desarrolle una audición funcional que permite en la mayoría de los casos implantados precozmente y sin discapacidades asociadas, alcanzar niveles de desarrollo de lenguaje oral muy similares a los niños oyentes. En este artículo trataremos de analizar precisamente el sentido de estos cambios a nivel del trabajo logopédico, pedagógico sobre todo cómo ha cambiado el enfoque del seguimiento familiar. ¿Qué es un Implante Coclear ?Un implante coclear puede ser definido como un aparato que transforma los sonidos y ruidos del medio ambiente en energía eléctrica capaz de actuar sobre las aferencias del nervio coclear, desencadenando una sensación auditiva en el individuo.

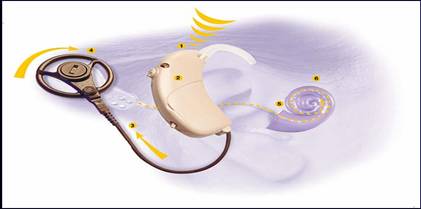

¿Cómo funciona el implante coclear?El implante coclear es un dispositivo que tiene dos grupos de componentes, uno externo y otro interno, que se implanta quirúrgicamente en el cráneo. Los componentes externos incluyen un micrófono ubicado detrás de la oreja, un procesador del habla que se usa en el cuerpo, y un transmisor que se lleva en el cuero cabelludo detrás de la oreja. Los componentes internos incluyen un receptor, un imán asegurado bajo la piel detrás de la oreja, y electrodos alámbricos colocados en la cóclea del oído. En algunos modelos más modernos, el procesador del habla y el transmisor se han combinado en una unidad y se pueden llevar al nivel del oído (se ve como una prótesis auditiva retro-auricular BTE, por sus siglas en inglés). El implante coclear recibe ondas de sonido a través del micrófono externo y las transforma en energía eléctrica especialmente codificada en el procesador de habla. Esa señal es transmitida a los electrodos internos que estimulan el nervio auditivo, el cual manda una señal al cerebro. Un otorrinolaringólogo especializado está a cargo de la cirugía de implante coclear en un hospital designado especialmente. Después de la cirugía y de un período de recuperación breve (un mes), la parte externa se adapta (por medio del proceso de cartografía) para el niño en cuestión. El proceso de cartografía o mapeo debe ser repetido con regularidad para asegurarse de que el niño está oyendo correctamente. Los niños con implantes cocleares son evaluados y supervisados por audiólogos pediátricos capacitados en cartografía o mapeo y supervisión de implantes cocleares.

Avances en los implantes coclearesEl tamañoEn los últimos 5 años el tamaño dell implante se ha reducido considerablemente sin perjudicar la calidad de audición. Los avances tecnológicos permiten procesar cada vez con mayor rapidez y claridad las señales acústicas y del lenguaje

La edad de la cirugíaSon muchos los equipos de implantes cocleares que realizan la intervención a partir de los 6 meses. El objetivo es restaurar el canal auditivo lo más precozmente posible para dar al niño la oportunidad de desarrollar el lenguaje en el periodo natural de su adquisición natural. La dificultad es conseguir un diagnóstico seguro en esas edades. Para conseguirlo es necesario que se pongan en marcha en las maternidades programas de cribado en los recién nacidos. Las técnicasLas técnicas quirúrgicas son cada vez menos invasivas y los electrodos atraumáticos. Esto hace que se pueda conservar parte de la coclea, que quedaría disponible para la aplicación de nuevos avances. Se piensa en un futuro no muy lejano, la posibilidad de combinar implante con prótesis La doble implantaciónLa colocación de 2 implantes hace que se pueda conseguir una mejor discriminación en ambientes ruidosos, que sea posible localizar los sonidos y sobre todo es importante estimular los dos oídos. De esta manera el niño sordo siempre podrá disponer de audición. Conceptos de aplicación del implante coclear.CodificaciónLas prótesis auditivas convencionales amplifican el sonido de forma linear pero la principal característica de las sorderas neuro-sensoriales es la variabilidad frecuencial de la perdida auditiva, consecuencia de un mal funcionamiento de la coclea cuyo papel consiste principalmente en codificar la información acústica antes de mandarla al cerebro. El implante no es un amplificador sino justamente un codificador cuya misión (y ambición) es realizar el trabajo de la coclea. La diferencia fundamental está en que la información dada por el implante es una información limitada pero estructuralmente representativa del sonido original Aprendizaje y plasticidad cerebralEl implante no le devuelve al niño una audición normal, tampoco se la da a partir de la 24ª semana de gestación como es el caso en un niño normo oyente : para aprovechar al máximo el implante es necesario un periodo de condicionamiento y aprendizaje cuya finalidad es ayudar al cerebro del niño a realizar lo que hará de forma natural si no fuese sordo, es decir darle sentido a los sonidos y asi estructurar patrones perceptivos Esta posibilidad cerebral está aún muy presente en el joven sordo l: un cerebro muy joven es capaz de adaptarse a las características de las entradas sensoriales, incluso si estas no corresponden al modelo estandar, pero sólo lo podrá realizar durante unos pocos años y mediante una estimulación precoz (Pasic et Rubel 1989). La adquisición del lenguaje y la sorderaHasta ahora todos nuestros esfuerzos para que un niño con sordera profunda pudiera desarrollar la comprensión y adquisición del lenguaje oral estaban centrados en la lectura labial, los signos manuales (lengua de signos o comunición Bimodal) los apoyos aumentativos como la palabra complementada y el lenguaje escrito: todo pasaba por el canal visual. La vuelta al uso del canal auditivo tiene consecuencias muy complejas tanto a nivel de aptitudes como la atención como en lo que se refiere a los procesos de tratamiento cognitivo y lingüístico de los mensajes orales. Concepto de audición funcionalEs importante distinguir entre lo que es una audición funcional y una audición normal, sobre todo para la familia que tiende a atribuirle al implante la remediación de la sordera. Las expectativas son muy altas y deben ser reajustadas individualmente a cada caso. La audición funcional es la capacidad de reconocer, por la vía auditiva mensajes verbales cuyos elementos ya son conocidos. Esta acuidad auditiva se desarrollará poco a poco, ampliando cada vez más la capacidad discriminativa del niño sordos que podrá en un momento dado utilizar su audición de forma eficaz en situaciones más amplias con algunas limitaciones (ejemplo de sitios ruidosos, conversaciones cruzadas...) A nivel pedagógico, con niños implantados, tenemos que recordar que la diferencia fundamental radica a nivel del aprendizaje ya que el nivel de audición durante los primeros años de la colocación del implante hasta que se consiga esa audición más eficaz, impide, retrasa o simplemente perturba la adquisición natural y automática de nuevas informaciones. Es necesario que los profesionales y los padres entiendan que entre esa audición deficiente y la funcional que será la que facilite la autonomía del niño, hay un periodo de estimulación especializada y de aprendizaje. ¿Quiénes son candidatos al implante?Los pacientes que presentan una hipoacusianeuro-sensorial bilateral profunda de origen coclear, que se benefician de forma insuficiente o nula de los audífonos Esta indicación se concreta en individuos con:

También están definidas algunas contraindicaciones como son:

Conclusiones

BibliografíaArchbold S. (1999) : Programa pediátrico de implante coclear en Nottingham. Integración. 10 . 6-11 Archbold S. y Lutman M. (1998) : Questionnaire of Nottingham Paediatric Cochlear Implant Programe - Univ. of Southampton. Huarte A. y Manrique M. (1999) : Implantes cocleares en niños prelinguales. en M. Monfort (ed.) : Logopedia,Ciencia y Técnica. Madrid. CEPE. Manrique M. y Huarte A. Implantes Cocleares Masson. 2002 Juárez A. y Monfort M. Doble Implantes cocleares. FIAPAS(2003) 93-94.76-81 Monfort M. y Juárez A. Algo que decir : una guía para padres de niños con sordera, de 0 a 5 años. Madrid: Enthaediciciones 2001 Pasic T.R. et Rubel E.W. (1989) : Rapid changes in cochlear nucleus cell size following blockage of auditory nerve electrical activity gerbils. J.Comp.Neurol. 283. 474-480 La Tecnología de FMA pesar de los continuos avances en las estrategias de procesamiento de la señal y la tecnología multimicrófonos los audífonos y los implantes no cubren por sí solos todas las necesidades auditivas del niño. Su mayor limitación se encuentra en la imposibilidad de enviar una señal clara y nítida del habla cuando existe ruido de fondo o cuando el usuario no está cerca del emisor. El proceso de aprendizaje a través de la audición depende en gran medida de un ambiente acústico favorable. La acústica del ambiente, en combinación con otras variables como la edad del niño, el grado y configuración de la pérdida auditiva, la intensidad de la señal de habla, la adaptación efectiva de los audífonos y/o implante coclear y los distintos dispositivos de ayudas técnicas determinarán la medida en la que el niño podrá escuchar y aprender. La acústica de una habitación depende de dos factores: el ruido de fondo y la reverberación. La relación o ratio Señal/Ruido es la comparación del nivel de intensidad sonora de la voz de la persona que habla en relación con el nivel de ruido de fondo y es lo que llega al sistema de amplificación del niño. Cuando el ruido de fondo supera los 60 dB, el beneficio de las prótesis es nulo. La reverberación es la especie de eco que se produce cuando el sonido se refleja en superficies duras y lisas como paredes, cielorrasos y escritorios. Este fenómeno degrada la señal de habla encubriendo y distorsionando componentes importantes. El tercer factor a considerar es la distancia entre el hablante y el niño. A medida que esta aumenta se reduce la intensidad de la señal. La distancia auditiva crítica es aquella dentro de la cual los sonidos del habla son inteligibles. Esta distancia, que se encuentra reducida en las pérdidas auditivas, varía de acuerdo a las cualidades acústicas del ambiente. El niño puede llegar a detectar e identificar todos los sonidos del habla cuando el ambiente es silencioso y el emisor se encuentra a menos de 1 metro de distancia, pero puede confundir o dejar de percibir algunos sonidos cuando el hablante se aleja o cuando hay ruido de fondo. La reducción de la distancia auditiva tiene consecuencias negativas en el aprendizaje incidental que puede llegar a realizarse a través de la escucha casual. Por eso es importante conocer cuál es la distancia auditiva crítica del niño para cada ambiente en donde se desenvuelve y modificar las situaciones en las que no tiene acceso a una señal auditiva óptima. Los sistemas de FM son una ayuda técnica para salvar los problemas derivados de las condiciones acústicas adversas. Los sistemas de FMEn general, los sistemas de FM consisten en un sistema de comunicación simple: un transmisor, un micrófono y un receptor. El micrófono se utiliza cerca de la fuente sonora y transmite la señal al receptor que emite dicha señal en forma amplificada. Cuando el receptor se acopla al oído del usuario, y esto puede realizarse de diferentes formas, se denomina Sistema de FM Personal. Los sistemas de FM personales proporcionan una comunicación directa entre la persona que habla y el usuario y ayudan a concentrase en las voces o sonidos que necesitan ser escuchados. Los sistemas de FM pueden ayudar a todos los niños que obtienen algún beneficio de sus audífonos y/o implante coclear debido a que actúan en forma conjunta con estos sistemas de amplificación primaria y por lo tanto están limitados por la eficacia de estas adaptaciones. Se recomienda su adaptación una vez que el niño tenga una programación y/o calibración estable en su sistema de amplificación primario y la familia esté familiarizada con el uso de las prótesis auditivas. Los sistemas de FM también pueden ser útiles en niños que nos son usuarios de audífonos, por ejemplo en aquellos con pérdidas auditivas leves o en aquellos que tienen dificultades en concentrarse en ambientes ruidosos. Los equipos de FM también están especialmente indicados en niños con Trastornos del Procesamiento Auditivo. a) Componentes

1. Emisora de FM El sistema de FM cuenta con un transmisor o emisora que recoge a través del micrófono el sonido que el niño necesita oír, lo convierte en una señal de radio y lo envía al receptor. Los transmisores utilizan la misma tecnología que las radios domésticas y proporcionan una señal sonora de alta calidad. La mayoría están diseñados para que la persona que habla los lleve cómodamente, por ejemplo en un bolsillo o sujetos al cinturón (1). Otros pueden sujetarse en la mano o colocarse en la mesa apuntando al orador.

2. Receptor de FM El receptor (2) capta la onda de radio enviada por el transmisor y la convierte en un sonido audible. El niño es quien utiliza el receptor. Actualmente los receptores se implementan a la parte inferior del audífono o al procesador del implante. El micrófono (3)es el que recoge la voz del orador o el sonido primario que se quiere transmitir y se comunica directamente con el transmisor. El micrófono de corbata es generalmente el más confortable para los profesores. Se sujeta en la ropa y debe estar de 10 a 15 cm. de la boca. En algunos de estos micrófonos existen opciones en las que, según se seleccione, puede captar los sonidos de todas las direcciones (omnidireccional) o dar preferencia a los sonidos de una dirección (direccional). Todos los receptores y emisores necesitan una antena para recibir y enviar la señal. A veces la antena está incorporada en el equipo. En muchos casos la antena es el mismo cable del micrófono. Es importante no cortar ni acortar la antena para no afectar el rendimiento del sistema.

4. Batería de la emisora de FM Todos los sistemas de FM necesitan baterías para el receptor y para el emisor. En los audífonos, la misma batería alimenta al receptor de FM. Esto implica que cuando está conectado el receptor de FM la pila del audífono se consume más rápido.La emisora utiliza otro tipo de batería que debe recargarse cada cierto tiempo de uso a través de un cargador similar al que se utiliza con los teléfonos móviles (4). b)Utilización El micrófono acoplado al transmisor recoge la señal y la envía en forma inalámbrica al receptor. En el receptor la señal es convertida nuevamente en una señal de audio y puede llegar al usuario a través de un auricular, el audífono o el procesador del implante.

c)Seguridad Las ondas de FM no son dañinas. Para poder ser aplicada con el uso de audífonos e implantes cocleares la conexión de FM tiene que trabajar con muy poca potencia, apenas 1mW, lo que limita la radiación electromagnética a valores casi inestimables. 1000 veces menos que el pico de radiación de un teléfono móvil, muy por debajo de los valores de seguridad. d)Conexión FM-Audífono Para conectar un sistema de FM al audífono es necesario que este tenga una entrada directa de audio. Hoy en día prácticamente todos la tienen, esto permite que la señal de FM entre directamente en el audífono proporcionando una señal de sonido de alta calidad. En esta entrada directa de audio se adosa una pequeña zapata llamada adaptador de audio a la cual se conecta luego el diminuto receptor (5).

5. Audífono retroauricular con adaptador de audio y receptor de FM Algunos audífonos digitales necesitan ser re-programados para funcionar correctamente con los sistemas de FM. Si el audífono tiene varios programas diferentes deberá informarse sobre cuál es el programa adecuado para el funcionamiento de la FM. Algunos audífonos de alta gama tienen incorporado el receptor de FM dentro de su carcasa (6).

6. Audífonos con FM integrada Muchos audífonos de conducción ósea tienen entradas directas de audio y pueden ser conectados a un sistema de FM de manera similar a los audífonos retroauriculares. El BAHA tiene una entrada directa de audio. Para chequear el funcionamiento del sistema de FM debe enviarse generalmente al fabricante del BAHA. e)Conexión FM-Implante Coclear El uso de sistemas de FM con el Implante Coclear está altamente recomendado. Generalmente el receptor del sistema de FM se conecta directamente al procesador del implante, aunque algunos procesadores necesitan un adaptador especial. Esta interfase lleva una pila de alimentación propia que debe renovarse periódicamente según el uso. Es muy importante utilizar el adaptador y los cables correctos. Es imprescindible que el equipo de implante programe el procesador para trabajar con la FM. Es importante tener en cuenta que cada vez que se chequea el sistema de FM en un IC sólo se tiene acceso al sonido que llega antes de ser procesado, debido a ello, si no es por los comentarios del niño, no se puede conocer directamente cuál es la calidad de sonido que está recibiendo, de allí la necesidad de evaluaciones funcionales.

7. Adaptador y receptor de FM para distintos IC g) Beneficios de los sistemas de FM Los efectos del ruido y de la reverberación se reducen debido a que la distancia entre la boca de la persona que habla y el micrófono es muy corta (de 15 a 20 cm. o menor). Debido a ello, la distancia deja de ser un problema porque la voz de la persona que habla llega a la persona que recibe la señal, a un nivel comparable al que se esperaría si esa persona que habla estuviera junto al receptor a menos de 50 cm. de distancia. No es necesario elevar la voz. Al ser la transmisión inalámbrica proporciona movilidad tanto al hablante como al niño sin verse degradada la calidad de la señal. Audífono/Implante Coclear y FM actúan en forma conjunta. El sistema de FM es transparente ya que respeta los parámetros y características dispuestos en el sistema de amplificación primario. El niño no queda desconectado del ambiente y es capaz de oír su propia voz ya que sigue recibiendo la información que capta el micrófono de su sistema de amplificación primario (Audífono/Implante Coclear). CONSEJOS PARA EL USO DE SISTEMAS DE FM 1. Asegurarse de que tanto el emisor como el receptor funcionan correctamente a través de un audioestetoscopio o preguntándole al niño cuando este es capaz de colaborar. 2. Situar el micrófono a 15- 20 cm de la boca del orador. 3. Activar el transmisor cuando el emisor se dirije a toda la clase o al grupo donde está trabajando el niño que lleva el sistema de FM. 4. Recordar desactivar el transmisor cuando se hable con otras personas o cuando la información que se transmite no es relevante para el niño que lleva el sistema de FM. 5. Utilizar el micrófono del transmisor en modo direccional. Tratar de no situarse en áreas ruidosas como cerca de una ventana ya que el micrófono puede captar también algo del ruido de fondo. 6. Si por algún motivo se debe gritar desactive el micrófono previamente. 7. Evitar el roce del micrófono con la ropa y/o colgantes/joyería. 8. Durante los debates en clase o los trabajos grupales fomentar que los niños que hablan se vayan pasando el micrófono. Sí esto no es práctico recordar hacer un resumen utilizando el micrófono- de lo que se ha dicho. 9. El sistema de FM puede conectarse a otros dispositivos como TV, ordenador, reproductor de CD, etc. Pedir asesoramiento al audioprotesista para realizar dichas conexiones. 10. No utilizar el sistema de FM sí este presenta algún fallo. Avances tecnológicos en las prótesis auditivas1. INTRODUCCIÓNLa aplicación de la tecnología a la corrección de pérdidas auditivas ha estado presente en nuestra sociedad desde tiempos muy lejanos. Durante mucho tiempo la única solución posible al problema de la sordera fue el uso de la trompetilla y otros utensilios que actuaban como simples resonadores. La aparición de la primera prótesis auditiva con amplificación eléctrica no vino hasta finales del siglo 19. Se habla de que Alexander Graham Bell inventó el teléfono después de construir un amplificador de audio para su esposa, que padecía de sordera. El problema que pretende solventar una prótesis auditiva (audífono), es la lesión o disfunción de alguno/s de los mecanismos que intervienen en el proceso de audición. Dichos mecanismos son complejos y todavía existen grandes interrogantes acerca de su funcionamiento. El problema con que nos enfrentamos a la hora de determinar el algoritmo de proceso más adecuado, es la falta de conocimiento del sistema de descodificación que realiza nuestro sistema auditivo. En la mayoría de las aplicaciones de ingeniería de audio, el objetivo es conseguir una señal lo más fiel posible, de alta calidad, no en vano todo sistema de audio comercial está pensado para personas con audición normal (normoyentes). Por ejemplo, en un sistema de grabación y reproducción, el objetivo es que la señal reproducida sea lo más parecida posible a la señal original registrada. Sin embargo, cuando pretendemos corregir una pérdida auditiva, nos enfrentamos a un sistema auditivo dañado. Existen suficientes evidencias experimentales de que el sistema auditivo es un sistema no lineal, variante e incluso podría decirse que es no causal, ya que existen fenómenos como el tinnitus o acúfenos, que producen una percepción acústica en ausencia de estímulos externos. Todo ello, hace que nos preguntemos si la señal que debemos entregar a un oído dañado, debe ser o no, lo más fiel posible a la original. A simple vista podríamos aventurar que la señal entregada debería presentar una cierta distorsión en amplitud, frecuencia y tiempo, opuesta a la distorsión provocada por el sistema auditivo dañado, de tal forma que ambas se compensasen. Ese planteamiento sería intachable si realmente pudiéramos acceder a los mecanismos fisiológicos que provocan todas esas distorsiones (de amplitud, frecuencia y tiempo). Sin embargo, la mejor vía de aplicación de la compensación de que se dispone hoy en día, es a través de la excitación acústica a nivel timpánico, mediante una señal previamente procesada. Existen prótesis auditivas que estimulan por otras vías (ósea, coclear y nerviosa), pero su aplicación se restringe a casos en que no es posible la estimulación por vía aérea. Durante las últimas dos décadas se han logrado desvelar importantes incógnitas acerca de la fisiología del sistema auditivo, que se han materializado en sistemas de proceso de señal propuestos por diferentes fabricantes. Sólo la profundización en dichos conocimientos ha hecho que valiera la pena la inversión en desarrollo tecnológico necesaria para implementar algoritmos de proceso muy complejos en el reducido espacio que requiere un audífono. El último paso en este desarrollo es la aplicación del procesado digital de señal a un audífono, que abre las puertas a un sinfín de posibilidades, cuya explotación depende de la continuidad en el avance del conocimiento sobre la fisiología de la audición. Además de los aspectos puramente científicos, existen toda una serie de condicionantes socioeconómicos en el mundo de las prótesis auditivas que no deben obviarse, ya que en gran medida condicionan las tendencias de la industria de este sector. Un factor importante, son las expectativas de la persona que decide comprar un audífono. La sordera, en la mayoría de los casos, obedece a una lesión sensorial, por lo que ninguna solución podrá restituir totalmente la audición perdida. Sí, en cambio, mejorarla. Por ello, en muchos casos, la prótesis auditiva no responde a las expectativas del paciente, derivando en una serie de procesos psicológicos que terminan en el rechazo de la misma, aunque objetivamente su percepción acústica se vea mejorada. Otro aspecto social importante en el mundo de las prótesis auditivas es la necesidad del paciente de ocultar su incapacidad. Por ello, el paciente procura obtener siempre la prótesis más pequeña posible, aún a costa de obtener de ella peores prestaciones que las que obtendría con una audífono más grande, con posibilidades de proceso de señal más avanzadas. La satisfacción de este tipo de necesidades sociológicas es un argumento que pesa hoy en día mucho en la industria. 2.- EVOLUCION DE LA TECNOLOGÍADurante muchos años, la tecnología disponible para ser aplicada a la construcción de prótesis auditivas no permitía ir mas allá de la obtención de simples amplificadores que solo eran razonablemente eficaces en las hipoacúsias de transmisión pero no podían abordar los problemas asociados a las hipoacúsias de percepción,( reclutamiento, mala discriminación frecuencial, audición en ruido, efecto Larsen..etc) , por lo que eran mal aceptadas o rechazadas por los afectados. También contribuía al rechazo el tamaño . Durante los años 70 y 80, el desarrollo de la tecnología electrónica en general permitió avanzar en algunos de estos problemas como el tamaño y el reclutamiento. El mayor logro fue en el tamaño gracias a la miniaturización de los componentes electrónicos ; mas modestos fueron los avances en el problema relativos a la diferente sensibilidad en la percepción en la escala de intensidad en las hipoacúsias sensoriales, (reclutamiento), que conlleva una mala audición para los sonidos de intensidad debil o media junto a una audición normal para los de intensidad fuerte o muy fuerte, dado que la voz presenta alteraciones naturales en la intensidad este fenómeno comporta una disminución de la inteligibilidad de la palabra junto a una sensación auditiva desagradable. Aprovechando las posibilidades de la miniaturización se pudieron instalar mas componentes en los circuitos e implementar diversos sistemas de AGC ,(en ingles Control Automático de Ganancia) que supusieron un avance importante pero todavía insuficiente para muchos usuarios de los audífonos. El resto de los problemas citados anteriormente, quedaban fuera de las posibilidades de la tecnología hasta este momento utilizada : PROCESO ANALÓGICO DE LA SEÑAL. Estaba claro que para poder avanzar en el proceso evolutivo de la tecnología aplicada a la industria de los Audífonos era necesaria la utilización de PROCESADORES DIGITALES DE SEÑAL, (DSP en ingles), que permitieran implementar algoritmos,(conjunto de instrucciones de proceso), acordes con los nuevos conocimientos de la fisiología de la audición. A finales de los años 80, el gobierno de EE.UU financio el llamado proyecto PHOENIX para el desarrollo de un audífono digital ; resultó un aparato muy grande cuyas prestaciones no mejoraron las ya disponibles en aquel entonces con la tecnología analógica. El problema era tecnológico ya que en aquella época no se disponía de circuitos digitales que funcionaran con bajo consumo y baja tensión por lo que tenia que alimentarse con fuentes de alimentación,(pilas), muy grandes; por otra parte, no se habían desarrollado las técnicas de integración de circuitos que permitiesen utilizar una gran cantidad de componentes en reducidos espacios. En la década de los 90, este desarrollo se produjo e hizo posible su utilización en los audífonos. En 1995, la empresa danesa WIDEX A/S lanzó al mercado el primer audífono digital de proceso avanzado en formato CIC,(Completamente Insertado en el Canal auditivo). En los últimos diez años transcurridos, los avances en la tecnología digital han sido considerables. De los 300.000 transistores que en 1995 utilizaba un audífono hemos pasado actualmente a 3.000.000. Ello ha permitido profundizar y avanzar en las soluciones a los problemas anteriormente citados. La aparición de la tecnología digital introduce en los audífonos unas mejoras protésicas importantes tanto en los aspectos cuantitativos (mayor amplificación del sonido), como cualitativos (mejor sensación acústica). La tecnología digital permite que los algoritmos del proceso de señal que son capaces de realizar los audífonos sean cada vez mayores, más rápidos y con menor consumo. Por ello, ya en los inicios del siglo XXI, el audífono digital está desplazando completamente al analógico. Con todo, conviene ser muy cauto en la selección del audífono digital más adecuado a cada usuario, puesto que no todos los audífonos denominados digitales poseen las mismas prestaciones. En ocasiones se ofertan audífonos digitales que únicamente presentan las mismas prestaciones que los audífonos analógicos. Por otra parte, y no menos importante, la adaptación correcta de un audífono digital de altas prestaciones requiere una elevada calificación profesional del audioprotesista y un instrumental técnico cada vez más complejo. Solo de este modo se garantiza que el usuario acceda a las prestaciones de un audífono digital de alta gama con las máximas garantías posibles de éxito. Nuevas tecnologías en la rehabilitación del niño sordo.La interacción social es fundamental para el desarrollo del lenguaje y de la cognición siendo la comunicación el mecanismo de mediación que facilita este desarrollo. Esto implica que los aspectos funcionales de la lengua se aprendan mediante interacciones significativas. Dentro de la población de deficiencia auditiva y teniendo en cuenta su diversidad (pérdida auditiva, momento del diagnóstico, tipo de prótesis, presencia de trastornos asociados...) encontramos ciertas características comunes que dificultan el mantener una interacción comunicativa adecuada:

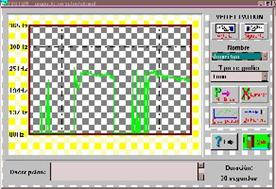

Dadas estas características es importante organizar y planificar actividades para crear situaciones comunicativas significativas en la intervención logopédica. En la actualidad contamos con una gran variedad de materiales para trabajar durante la intervención con deficientes auditivos. Muchos de ellos lo encontramos en soporte informático, no obstante, el logopeda deberá conocer qué programas informáticos pueden servirle en cada caso particular. Previamente se debe realizar una evaluación del programa elegido, considerar su utilidad y realizar una evaluación final de su eficacia dentro del contexto empleado. Estos recursos tienen como objetivo el desarrollo y la mejora del habla y del lenguaje favoreciendo: - el descubrimiento de estrategias de resolución de problemas. Pero el desarrollo de estas interacciones no pueden ser concebidas como exclusivas de una relación individual entre el programa- el/la niño/a sino que debe plantearse la interacción entre programa-logopeda-niño/a. Algunos de los programas que podemos encontrar en el mercado para niños con deficiencia auditiva son los siguientes: 1) Programas para trabajar la voz, habla y audición1.1) SPEECH VIEWER IIIDistribuido por: IBM Contacto: http://www-3.ibm.com/able/snsspv3.html Aspectos que desarrolla: se basa en el biofeedback visual inmediato que recibe el individuo de sus producciones orales, mostrándole las características de su habla: tono, intensidad, sonoridad, duración, espectros, pronunciación de fonemas,articulación.

Valoración : ofrece interfaces muy atractivas para que los/as niños/as puedan comprender la relación entre el fenómenos visual y el oral con gran motivación.  1. 2) SistemavishaDistribuido por: Departamento de Ingeniería Electrónica ETSI de Telecomunicación. Universidad Politécnica de Madrid. Aspectos que desarrolla: características de la voz y el habla Descripción del programa: Dispone de los siguientes programas para trabajar:

Valoración: Es similar en sus objetivos al Visualizador Fonético de IBM pero las aplicaciones son menos atractivas y su diseño es algo más anticuado.

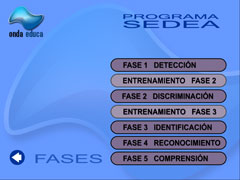

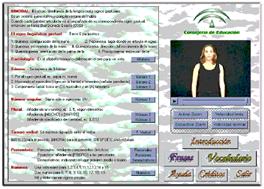

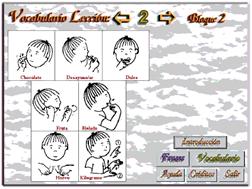

1.3) Sistema AVELElaborado por: EGESA (ELECTRONICA GENERAL ESPAÑOLA, S.A.) Distribuido por: ORTOTECSA , S.L. Aspecto que desarrolla: reconocimiento de parámetros vocálicos Descripción del programa: es un programa para el reconocimiento de voz, basado en una tarjeta analógica incluida en un ordenador PC compatible. La entrada se realiza mediante un micrófono unido a una unidad de control que se conecta al ordenador. Permite el desarrollo de programas de desmutización, articulación vocálica correcta, ejercicios de ritmo, control de tono y de intensidad 1.4) IsotonElaborado por: Dpto. ingeniería Electrónica E.T.S.I. Telecomunicaciones. Página web: http://www.etsit.upm.es Distribuidos por: Dpto. ingeniería Electrónica E.T.S.I. Telecomunicaciones Aspectos que desarrolla: Permite entrenar tres parámetros del habla: intensidad, sonoridad y tono fundamental. Descripción del programa: es un sistema para el entrenamiento del habla, basado en la imitación de patrones establecidos por el logopeda o en el control de videojuegos por voz. 1.5) PIPADistribuido por: TEA Ediciones. Página web: http://www.teaediciones.es Aspectos que desarrolla: entrenamiento auditivo. Descripción del programa: programa interactivo de percepción auditiva. Dirigido a psicólogos, pedagogos y logopedas para trabajar con niños la percepción y discriminación auditiva. 1.6) Programa Sedea (programa secuenciado de desarrollo auditivo)Desarrollado entre: el Equipo de Rehabilitación del Colegio La Purísima para niños sordos de Zaragoza y los profesionales de la empresa onda Educa. Distribuido por : onda Educa ( mcm@ondaeduca.com) Aspectos que desarrolla: la atención, localización, discriminación, asociación entre imagen y sonido, identificación, reconocimiento, memoria y comprensión auditiva. Descripción del programa: está secuenciado para ser usado en función de la etapa auditiva en que se encuentra el niño permitiéndonos ir trabajando con el alumno de una manera secuenciada desde la detección de sonidos cotidianos hasta llegar a situaciones de habla compleja como el diálogo o la conversación, facilitando la comprensión con recursos complementarios como la lectura labial, las ilustraciones o el texto. Valoración:es un programa de fácil manejo ya que hace posible la interacción del alumno con los contenidos, de manera que pueda verse incrementada su motivación y participación. Otra de las características más importantes de SEDEA es que resulta un Programa abierto y actualizable, es decir, ha sido diseñado con la intención de en un futuro poder incorporar nuevos contenidos, sonidos y actividades que se ajusten a los intereses y necesidades de los usuarios, por ejemplo en función de su edad o lengua.   1.7) Memoria auditiva secuencial:Distribuido por: Escola Patología Llenguatge. Hospital Santa Creu y Sant Pau. Página web: http://www.cbi.es/epl Aspectos que desarrolla: Programa con ejercicios para trabajar la memoria auditiva secuencial y para los problemas de agnosia auditiva. 2) Software educativo para la adquisición y desarrollo de habilidades lingüísticas orales y escritas2.1) Programas PEL de Estimulación Lingüística Marc Monfort, Adoración Juárez, Luis de Mena, Santiago Aguilera)Distribuido por: CEPE. Aspecto que desarrolla: Es un programa orientado al ámbito educativo para la mejora del nivel lector y ortográfico. Descripción del programa: aporta elementos de motivación y refuerzo e informa de la duración del ejercicio y visualiza los resultados. Valoración: permite editar palabras y frases, así como configurar determinados parámetros. Resultan motivantes para el/la niño/a los iconos sencillos, señales sonoras y pequeñas animaciones que le indican si la actividad es realizada correctamente o no. 2.2) CLICDistribuido por: el PIE (Programa de Informática Educativa de la Generalitat de Catalunya) y MEC-PNTIC. Aspectos que desarrolla : áreas curriculares. Descripción del programa: permite crear actividades educativas para infantil, primaria y secundaria. También es un buen recurso para utilizar con alumnos de necesidades educativas especiales y dentro de este grupo los alumnos con deficiencia auditiva. Dispone de cuatro tipos de actividades: rompecabezas, asociaciones, sopas de letras y crucigramas. Valoración :Desde el servidor PIE en Internet podemos disponer de numerosas aplicaciones creadas por distintos profesionales de la educación. 2.3) SIMICOLE 2002. Sistema Multimedia de Instrucción de la Comprensión Lectora (Proyecto MAS)Desarrollado por: la Unidad de Investigación Acceso de la Universidad de Valencia en colaboración con la Asesoría Universitaria de Estudiantes con discapacidad de la misma universidad y la Federación de Personas Sordas de la Comunidad de Valencia (FESORD-CV) Distribuido por: http://acceso.uv.es/Unidad/pubs/2001-isaac/Isaac2001_MAS.htm Descripción del programa es una aplicación informática destinada a personas sordas adultas, para mejorar las habilidades relacionadas con la comprensión lectora. Contiene 30 ejercicios relativos a 10 temas que se reparten en tres niveles de dificultad a razón de 10 textos por nivel. 2.4) HamletDistribuido por: la empresa Aquari Softz (correo@aquari-soft.com) Aspectos que desarrolla: se puede utilizar en el entrenamiento de conceptualización fonológica en todas aquellas patologías que lo requieran, no sólo en dislalias fonológicas, sino también en retrasos de habla y lenguaje. También se puede usar en procesos anómalos de lecto-escritura por mala codificación fonológica. Descripción del programa: está organizado en series de ejercicios que se componen de imágenes y sus voces correspondientes. Hay ejercicios de 8 y 16 imágenes y tres modos de presentación: secuencial, múltiple y múltiple con modelo. Valoración: es un programa abierto pues posibilita una individualización total. Podemos construir ejercicios de conceptualización fonológica para cada caso así como una evaluación de cada sesión y de todo el tratamiento desde la fecha que elijamos.   Además la empresa Aquari Soft distribuye otros programas específicos tales como Dictados para aprender a escribir, Herramientas para la lectura y escritura, Comprensión lectora nivel I, II, III 2.5) Otros programasEl programa EXLER es un buen recurso para trabajar la segmentación de las palabras, habilidades lingüísticas de comprensión y expresión oral- escrita. Distribuido por Hospital de Sant Pau (versión completa) y Departament d´Ensenyament de la Generalitat de Catalunya (versión 2.01) en el CD-ROM Sinera. El programa Gram fue creado de manera específica para alumnos sordos y trabaja las formas verbales a partir de una serie de textos. Creado por Fundación La Caixa. No tiene sonido. Son muy útiles las secuencias de imágenes con algún movimiento, ya que permiten elaborar lenguaje para poder explicar lo que está ocurriendo. El proyecto LAO, actualmente en desuso, fue un recurso específico para el trabajo de segmentación silábica y fonológica en alumnos sordos. 3) Programas que combinan el lenguaje oral y /o escrito y el lenguaje de signos:3.1) DITS(José Luis Rodríguez Illera)Realizado por : la Universidad de Barcelona Descripción del programa : consta de varios niveles y la posibilidad de realizar un test.

Valoración: permite añadir/eliminar palabras y listas, así como modificar la velocidad de presentación de los signos, además, la navegación es libre por el programa, eligiendo aquellas opciones que le interesen al usuario. En el portal www.planetavisual.net se dispone de un traductor dactilológico: http://www.planetavisual.net/right/diccio/index.htm 3.2 Signos 97-98Distribuido por : Cubic Informatica S.L. Descripción del programa: funciona como un diccionario bilingüe donde se desarrollan actividades de ejercitación y práctica. Contiene información visual: imágenes, vídeo y texto escrito (palabras, frases, información gramatical, ). Hay una pantalla principal donde se introduce la palabra escrita para ver el signo correspondiente (se dispone de 1.000 signos aproximadamente) y otras informaciones adicionales (sinónimos, observaciones y parámetros). Valoración: El programa permite visualizar desde cualquier pantalla las opciones de trabajo. Dispone de iconos de navegación para moverse por el programa que son claros y de fácil manejo. 3.3) Signe-2Desarrollado por : Benjamí Vidiella. Distribuido por : http://www.xtec.es/recursos/prg_educ/signe.htm (de forma gratuíta) Descripción del programa: es un editor de lenguaje de signos que permite crear textos en lenguaje escrito y traducirlos a lenguajes gráficos (sistemas pictográficos, fotos...) o a la Lengua de Signos. Permite relacionar a cada unidad léxica del texto escrito con una imagen, generalmente de la lengua de signos. 3.4) Otros programas:3.4.1)El aprendizaje autónomo de signos de la comunicación Bimodal( Cd1, Cd2) asistido por ordenador (2000). Autor: José Sánchez Rodríguez.  3.4.2) El curso multimedia para el aprendizaje básico de La Palabra Complementada (como sistema aumentativo del habla). Autores: José Sánchez Rodríguez y María José Ruiz Casas.4) Otros programas no específicos para niños con necesidades educativas especiales que se pueden utilizar:4.1) El español es fácil:Distribuido por. el MEC-PNTIC Aspectos que desarrolla: capacidad comunicativa, desarrollar la comprensión/ expresión oral y escrita, así como ampliar el vocabulario. Valoración: Es un programa que en principio fue pensado para alumnos/as procedentes de los países del Norte de África y escolarizados en nuestro ámbito geográfico, aunque los objetivos que trabaja pueden beneficiar también a otros alumnos como los que presentan deficiencia auditiva. 4.2) El flautista de Hamelín:Distribuido por : EDICINCO S.A. Aspectos que desarrolla : la motivación para la lectura Descripción del programa : El programa gira en torno al cuento de «El Flautista de Hamelín» y se estructura en tres módulos:

Valoración: Las pantallas de esta aplicación tienen un diseño estético y claro. Para el trabajo de deficientes auditivos el módulo más interesante es el que desarrolla el cuento. 4. 3) Trampolín. Educación Infantil. Primer y segundo CicloDistribuido por: Anaya Inter-activa y Knowledge Adventure. Descripción del programa: Hay múltiples elementos de audio y animaciones, unas de forma automática y otras al hacer clic sobre distintos elementos. Ofrece numerosos juegos y «sorpresas» con animaciones y canciones. Valoración: No existe un menú de contenidos. Éstos se van descubriendo por exploración. Se puede graduar el nivel de dificultad. En el mercado también encontramos otros programas como: Pequeabecedario, La magia de las letras, Juega con las palabras, ADI, WIN-ABC, PAAL, ACCI-LEC-CON, Silbo me enseña a leer (estos cuatro últimos distribuidos por el MEC), que facilitan el acceso de la lecto-escritura a los alumnos con deficiencia auditiva, aunque no han sido creados específicamente para ellos. Algunos de los objetivos a conseguir por estos programas son los siguientes: trabajar la conceptualización fonológica, la construcción de palabras escritas, y las habilidades lectoescritoras. 5) Conclusiones:El artículo aporta una visión de los distintos programas informáticos que podemos utilizar como profesionales para nuestro trabajo con los niños deficientes auditivos. Hemos querido precisar el uso de estos software informáticos y la aplicación que tiene para la mejora de aspectos tan importantes como son la atención, la memoria, los conceptos espacio- temporales, las estructuras sintácticas, el léxico La introducción en nuestro trabajo logopédico de las nuevas tecnologías ayuda a que los alumnos deficientes auditivos saquen el mayor rendimiento a sus sesiones ya que estos programas permiten combinar la sistematización del trabajo de conceptos y habilidades, pero dentro de un contexto lúdico y competitivo. Igualmente destacar que muchos de estos programas se pueden realizar con la familia, puesto que el propio programa controla los parámetros que se quieren ejecutar. Será tarea del pedagogo elegir el programa que corresponda mejor a las necesidades del alumno. BIBLIOGRAFÍAAELFA (boletín nº1/2004) Herramientas informáticas para la intervención en logopedia. Francisco Alcantud Marín y Francisco Javier Soto Pérez (2003) Tecnologías de ayuda en personas con trastornos de comunicación, colección Logopedia e Intervención, editorial Nau Libres. Marc Monfort y Adoración Juárez (1988) El ordenador y los trastornos del lenguaje escrito, publicado por el Real Patronato de prevención y de atención a personas con minusvalía. Miguel Puyuelo Sanclemente y Mª Pilar San José Alagón (1999) Deficiencia auditiva. Aspectos neuropsicológicos y comunicativos. Intervención por medio de softwear educativo y técnicas de biofeed-back. First Internatinal Congreso on Neuropshychology in Internet. En internet: http://w3.cnice.mec.es/recursos2/atencion_diversidad/01_02_03d.htm http://usuarios.discapnet.es/ojo_oido/sistemas_tecnicos_informaticos_para_niños_sordos.htm http://www.juntadeandalucia.es/averroes/recursos_informaticos/programas/bimodal2000.php3 y http://www.juntadeandalucia.es/averroes/recursos_informaticos/programas/bimodal2000_2.php3 http://www.juntadeandalucia.es/averroes/recursos_informaticos/programas/lpc.php3 |